Stuttgart, 16. Januar 2025 – Seedbox.ai stellt in Zusammenarbeit mit dem Höchstleistungsrechenzentrum Stuttgart (HLRS) und dessen heute eingeweihten Supercomputer Hunter die Entwicklung einer neuen KI-Modellgeneration vor. Dieser wurde noch vor der offiziellen Inbetriebnahme einem umfangreichen Stresstest unterzogen, bei dem der Stuttgarter KI-Technologieentwickler als erstes Unternehmen überhaupt den Supercomputer für das Training großer Sprachmodelle nutzen kann. Gemeinsam mit dem HLRS sowie den beiden Technologiepartnern AMD und Hewlett Packard Enterprise (HPE) unterstreicht Seedbox.ai mit der Vorstellung der neuesten KI-Modellgeneration (Kafka-Llama-3.1) erneut seine Rolle als Vorreiter in der Entwicklung multilingualer und sicherer KI „Made in Germany“.

Für das sprachlich und kulturell vielfältige Europa sind eigene KI-Modelle von strategischer Bedeutung. Sie bieten eine Alternative zu bestehenden internationalen Lösungen, die oft nur für monolinguale Kontexte der führenden Hauptsprachen optimiert sind. Aus diesem Grund werden die KafkaLM-Modelle von Seedbox.ai mit spezifischen Datensätzen in 24 europäischen Sprachen trainiert, wobei der verwendete Sprachdatensatz sich immer an der anteiligen Sprachverteilung in Europa orientiert. Dies ermöglicht die Eingaben in jeder europäischen Sprache und präzise Ausgaben in derselben oder einer anderen Sprache, ohne signifikante Qualitätsverluste durch generische Übersetzungsprozesse. Dabei bleiben sprachliche und kulturelle Nuancen erhalten und können in allen Anwendungen präzise abgebildet werden.

Doch die neuen KafkaLM-Modelle werden noch weiter gehen: Neben Text-zu-Text-Funktionen ermöglichen sie zeitnah die nahtlose Kombination vielfältiger Eingabe- und Ausgabeformate. Texte können in hochwertige Audioausgaben umgewandelt oder auch Bilder in erklärende Texte überführt werden. Diese multimodalen Fähigkeiten erweitern die Einsatzmöglichkeiten erheblich und fördern die Interoperabilität von Daten über verschiedene Formate hinweg. Unternehmen profitieren beispielsweise im Kundensupport und in der Mitarbeiterkommunikation, indem Chatbots präzise und fließend in jeder verfügbaren Sprache agieren, oder durch die Generierung mehrsprachiger Dokumente für ihre globalen Geschäftsprozesse. Dies kommt auch Regierungen für die internationale Kommunikation oder bei Bürgerinformationen zugute. Auch Forschungseinrichtungen können mithilfe der Modelle historische Texte analysieren und fortschrittliche Spracherkennungssysteme entwickeln, die eine barrierefreie Kommunikation fördern.

Relevanz für Deutschland und Europa

Die KafkaLM-Modelle leisten einen zentralen Beitrag zur digitalen Souveränität Europas, indem sie den Zugang zu innovativer KI-Technologie fördern, regionale Anforderungen berücksichtigen und gleichzeitig die Abhängigkeit von außereuropäischen Anbietern reduzieren. Seedbox.ai setzt hierbei auf eine starke Technologieexpertise, schlanke und innovative Prozesse sowie den gezielten Einsatz modernster Technologien und Trainingsmethoden. Der Fokus liegt dabei bewusst auf der Nutzung und Weiterentwicklung von Open-Source-Modellen, um Effizienz und Flexibilität zu maximieren. Dadurch werden Ressourcen effizient eingesetzt, statt sie in die Neuentwicklung bereits global verfügbarer Standards zu investieren. Die zukunftsgerichteten Investitionen des Landes Baden-Württemberg in hochmoderne Supercomputing-Ressourcen, wie den Supercomputer Hunter, bilden die Grundlage für die Entwicklung souveräner KI nach EU-Standards. Diese Investitionen stärken nicht nur die technologische Position des Landes, sondern erhöhen auch die Wettbewerbsfähigkeit Baden-Württembergs und Deutschlands im globalen Vergleich.

„Unsere Modelle sind speziell auf die Anforderungen europäischer Unternehmen und Institutionen ausgerichtet und setzen neue Maßstäbe in Effizienz, Sicherheit und Sprachvielfalt“, betont Dennis Dickmann, CTO von Seedbox.ai. „Dieser Erfolg ist das Ergebnis der engen Zusammenarbeit mit unseren Partnern HPE und AMD sowie der strategischen Unterstützung und Rechenpower des HLRS.“

Effizienter und sicherer Einsatz von KI

Die KafkaLM-Modelle richten sich an eine breite Zielgruppe, die unabhängig von proprietären, meist amerikanischen Modellen agieren und innovative Produkte speziell für europäische Sprachen entwickeln möchte. Besonders Organisationen mit sensiblen Daten profitieren von einer sicheren, lokalen Lösung, die sich nahtlos in bestehende Infrastrukturen integrieren lässt. Durch die Bereitstellung der Modelle auf der zertifizierten Infrastruktur des Bundeshöchstleistungsrechenzentrums werden stets höchste europäische Datenschutz- und Sicherheitsstandards gewährleistet.

Neben der Sicherheit gewinnen Effizienz und Innovation in Unternehmensprozessen zunehmend an Bedeutung. Die KafkaLM-Modellfamilie bietet hierfür eine ideale Basis, indem sie sowohl für klassische Automatisierungslösungen als auch für die Entwicklung autonomer, intelligenter Systeme (Agentic AI) optimiert ist. Diese Systeme können selbstständig agieren und zusätzliche Optimierungspotenziale erschließen.

Hunter: Ein wichtiger Schritt in die Zukunft

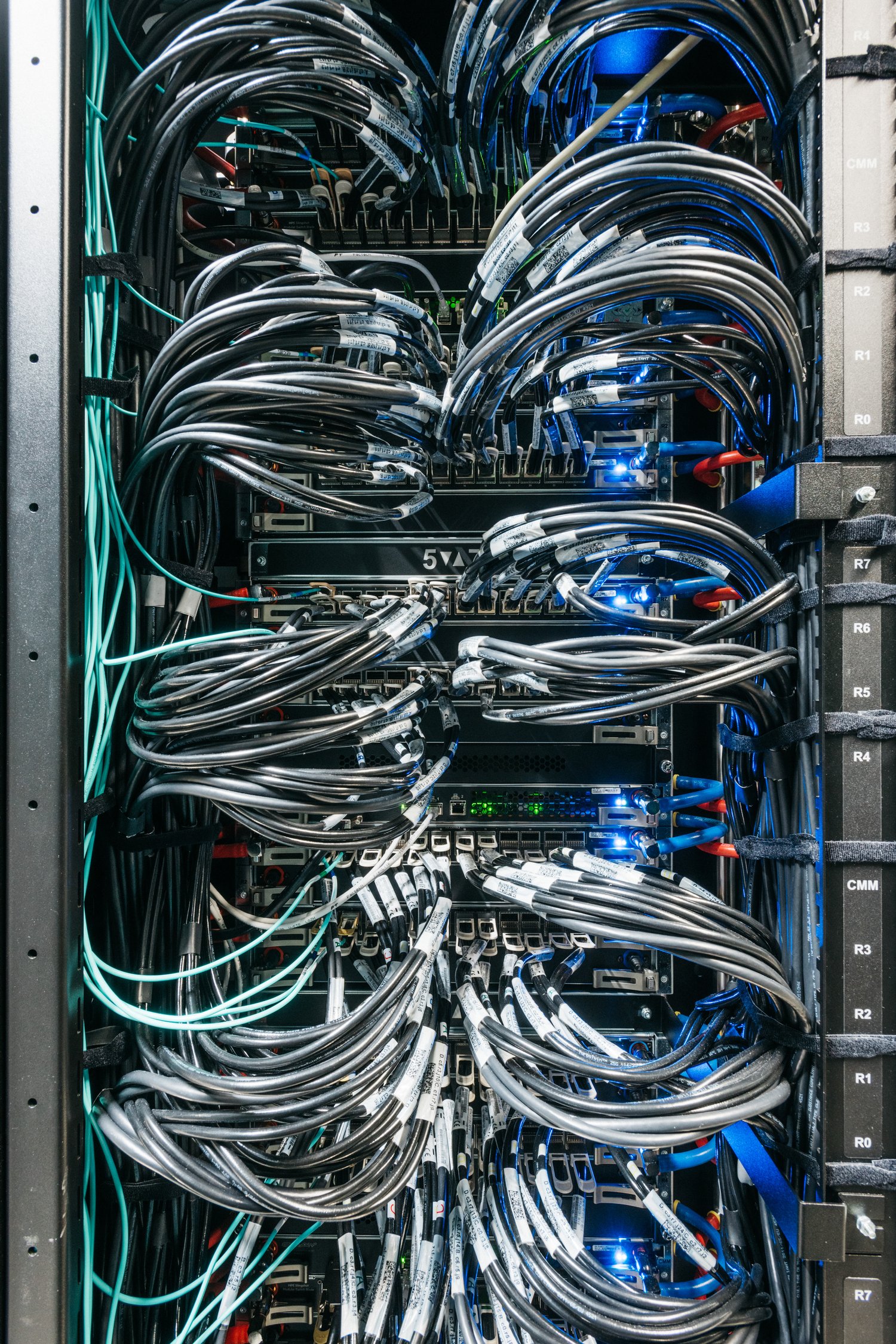

Die neuen KafkaLM-Modelle (8B und 70B) werden heute und auch künftig auf dem neuen Supercomputer des Höchstleistungsrechenzentrums Stuttgart trainiert. Der von HPE für das HLRS entwickelte Supercomputer „Hunter“ bietet eine hochflexible Infrastruktur, die optimal auf zukünftige Anforderungen ausgelegt ist. Mit seinen MI300A-APUs und der von Seedbox.ai entwickelten Optimierungs-und Trainingspipeline wird Hunter verschiedene Open-Source-Modelle für eine breite Nutzerschaft zugänglich und effektiv nutzbar machen. Dies fördert die Demokratisierung moderner KI-Technologien und schafft die Grundlage für neue innovative Anwendungen. Ein zentraler Ansatz zur Verbesserung der Energieeffizienz beim Training der Modelle auf Hunter war dabei die Pruning-Methodik, bei der weniger relevante Verbindungen in neuronalen Netzwerken entfernt werden, um Modelle ressourcenschonender betreiben zu können. Diese Technik steigert sowohl die Effizienz als auch die Leistungsfähigkeit, unterstützt durch die energieeffiziente Infrastruktur des HLRS, das nach EMAS zertifiziert ist. Seedbox.ai und das HLRS zeigen gemeinsam, wie kluge Algorithmen und energieoptimierte Supercomputing-Technologie nicht nur Europas KI-Entwicklung voranbringen, sondern auch einen wichtigen Beitrag zur Nachhaltigkeit leisten kann.

„Die Architektur von Hunter spiegelt die Veränderungen im Höchstleistungsrechnen (HPC) aufgrund der rasanten Entwicklung der künstlichen Intelligenz wider“, sagte Prof. Michael Resch, Direktor des HLRS. „Traditionelle HPC-Simulationsmethoden bleiben weiterhin relevant – doch KI bietet ein großes Potenzial für neue Anwendungen, die gerade erst in den Fokus rücken. Als Bundeshöchstleistungsrechenzentrum stellt das HLRS modernste Recheninfrastruktur und -ressourcen zur Verfügung, um Spitzenforschung zu unterstützen, industrielle Innovationen zu beschleunigen und globale Herausforderungen zu bewältigen. Unsere auf KI fokussierte Partnerschaft mit Seedbox.ai zeigt bereits jetzt, wie Hunter und unsere zukünftigen Systeme die Lösung aufkommender Herausforderungen auf neue Weise unterstützen könnten“.

Vision und Zukunftsaussichten

Diese hier aufgeführten Entwicklungen markieren einen entscheidenden Schritt in der Zusammenarbeit von Seedbox.ai und dem HLRS: dem Aufbau einer souveränen europäischen KI-Infrastruktur. Durch ein gefördertes Innovationsprojekt im Rahmen der FFplus Initiative zum Thema “Adaptive Prompt Routing and Hallucination Detection for Enhanced Multilingual Open-Source LLMs”, das im ersten Quartal beginnt, wird Seedbox.ai weitere Modelle trainieren und ergänzende Services dazu entwickeln. Die daraus entstehende Gen KI-Plattform bietet dann kleinen und mittleren Unternehmen, Startups sowie Forschungseinrichtungen einen einfachen Zugang zu leistungsstarker KI-Technologie. Sie vereint Tools zur LLM-Optimierung mit der Möglichkeit, Generative KI nahtlos in Systeme, Anwendungen und Prozesse zu integrieren. Die Kombination aus der flexiblen und lokalen Bereitstellung von Open-Source-Modellen via API-Schnittstelle und der leistungsstarken HPC-Infrastruktur eines HLRS bietet dabei einen großen Mehrwert.

Mit dem Aufbau von HammerHAI, der ersten AI Factory mit Sitz in Deutschland, schließt sich der Kreis. In der Anfangsphase spielt Hunter weiterhin eine zentrale Rolle, indem er für erste Anwendungen genutzt werden kann, bis ein neuer Supercomputer rein für den Einsatz von KI, Anfang 2026 am HLRS installiert und betriebsbereit ist. Dieses mit 85 Millionen Euro geförderte Projekt des EuroHPC JU wird ein umfassendes Portfolio an Tools und Services entwickeln, um den Zugang zu KI-Technologien zu erleichtern und deren Nutzungskosten zu senken. Seedbox.ai ist als offizieller Commercial Partner aktiv an der Umsetzung beteiligt und verbindet Spitzenforschung mit industriellen Anwendungen für maximale Effizienz und Innovation.

„Wir haben in Deutschland gemeinsam mit unseren starken Unternehmen und Partnern schon heute die Grundlagen geschaffen, um in der KI-Entwicklung eigenständig und selbstbewusst voranzugehen. Jetzt ist der Moment, mutig zu handeln, die Kräfte zu bündeln und Deutschland wieder zukunftssicher sowie global wettbewerbsfähig aufzustellen.“ appelliert Kai Kölsch, CEO von Seedbox.ai.

Werden Sie Teil der Zukunft europäischer KI!

Lassen Sie uns gemeinsam die Potenziale von KafkaLM ausschöpfen und die Erfolgsgeschichte innovativer KI-Lösungen „Made in Europe“ weiterschreiben. Kontaktieren Sie uns und gestalten Sie mit uns die nächste Generation technologischer Innovationen.

Über Seedbox.ai

Seedbox.ai entwickelt maßgeschneiderte KI-Lösungen für die deutsche Industrie. Sie begleiten Unternehmen von der Ideenvalidierung über die Entwicklung effizienter, kostengünstiger Proof-of-Concepts (PoC) bis hin zur Umsetzung komplexer KI-basierter Softwareanwendungen und dem Training unternehmensspezifischer KI-Modelle.

Ihre Expertise umfasst maschinelles Lernen, Deep Learning, NLP und Computer Vision, mit einem besonderen Fokus auf generative KI. Neben der Zusammenarbeit mit Wirtschaftsunternehmen widmet sich Seedbox.ai der Grundlagenforschung und der Entwicklung multilingualer Open-Source-Modelle*, um generative KI zu demokratisieren und in nutzerzentrierte Anwendungen zu integrieren.

Seedbox.ai steht für nachhaltige, ethische und sichere KI-Lösungen, die nicht nur aktuelle Herausforderungen adressieren, sondern auch die Basis für eine zukunftssichere und souveräne Entwicklung schaffen.

Fachlicher Kontakt Seedbox.ai

Dennis Dickmann – CTO & Co-Founder, Seedbox Ventures GmbH,

Tel.: +49 176 / 10537621, dennis.dickmann(at)seedbox-ai.com

Pressekontakt Seedbox.ai

Kai Kölsch – CEO & Co-Founder, Seedbox Ventures GmbH,

Tel.: +49 176 / 64124749, kai.koelsch(at)seedbox-ai.com

Mehr Information zur KafkaLM-Modellfamilie finden sie unter https://kafkalm.com/ und besuchen Sie gerne unser Unternehmen auf https://www.seedbox.ai/

Über das Höchstleistungsrechenzentrum Stuttgart

Das Höchstleistungsrechenzentrum der Universität Stuttgart (HLRS) wurde 1996 als erstes Bundeshöchstleistungsrechenzentrum Deutschlands gegründet. Als Einrichtung der Universität Stuttgart und Mitglied des Gauss Centre for Supercomputing stellt das HLRS seine Rechenkapazitäten Nutzer:innen aus Wissenschaft und Industrie zur Verfügung. Das HLRS betreibt modernste Höchstleistungsrechensysteme und bietet als Experte für neueste Technologien erstklassige Weiterbildung in den Bereichen Programmierung und Simulation. Das Zentrum forscht an wegweisenden Fragestellungen und Technologien rund um die Zukunft des Höchstleistungsrechnens (HPC). Die HLRS-Expertise umfasst unter anderem die Bereiche parallele Programmierung, numerische Methoden für HPC, Visualisierung, Cloud Computing, Höchstleistungsdatenanalyse (HPDA) sowie künstliche Intelligenz. Die Nutzer:innen der Systeme des Zentrums forschen auf ganz unterschiedlichen Forschungsgebieten mit dem Schwerpunkt auf Ingenieurwissenschaften und angewandter Wissenschaft.

Pressekontakt HLRS

Sophia Honisch – Leiterin, Public Relations, Höchstleistungsrechenzentrum Stuttgart,

Tel.: +49 (0)711 / 685-68038, honisch(at)hlrs.de